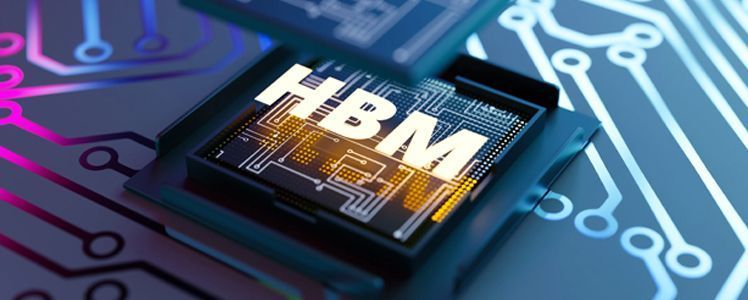

HBM, also High Bandwidth Memory, ist eine Technologie, die in den letzten Jahren zu einem unverzichtbaren Element von Hardware wurde, die in AI, HPC und Rechenzentren eingesetzt wird. Hier geht es nicht nur um eine weitere Version von Speicher – es geht um eine völlig neue Architektur, die es Beschleunigern ermöglicht, schneller, effizienter und energieeffizienter zu arbeiten. In diesem Beitrag sehen Sie, warum KI-Ingenieure HBM lieben, wie ihre Entwicklung aussieht, was sie wirklich kostet – und warum trotz dieser Kosten niemand mehr in Richtung klassischer DRAMs schaut.

HBM ist nicht nur ein neuer Speichertyp – es ist eine Architektur für AI, wie es sie bisher nicht gab

Beginnen wir mit den Grundlagen. High Bandwidth Memory (HBM) ist eine DRAM-Technologie, die für maximale Bandbreite und minimalen Energieverbrauch entwickelt wurde, hauptsächlich verwendet in Grafikchips und AI-Beschleunigern. Im Unterschied zu klassischen DDR- oder GDDR-Modulen basiert HBM auf vertikaler Anordnung von DRAM-Chips, verbunden mittels TSV (Through-Silicon Vias) und integriert mit dem Prozessor unter Verwendung von Silizium-Interposern. Das ist nicht nur ein neuer Speichertyp – das ist eine völlig neue Art, über Speicherzugriff zu denken.

In der Praxis bedeutet diese Architektur eines: deutlich kürzere Signalwege, höhere Packungsdichte und beispiellose Datenbusbreite. Ein HBM-Stapel kann eine Busbreite von bis zu 1024 Bit haben, während GDDR normalerweise mit 32 Bit arbeitet. HBM3E, eingeführt 2023, erreicht bis zu 1229 GB/s Bandbreite bei 48 GB Kapazität pro Stapel, was heute GPUs ermöglicht, riesige Datensätze ohne Verstopfung der Puffer zu verarbeiten.

Und das ist erst der Anfang – HBM4 (geplant für 2026) soll bis zu 1,6 TB/s bei 64 GB Kapazität erreichen. Im Kontext von AI- oder HPC-Infrastruktur ist das ein Spielwandler, der die Skalierung von Arbeitslasten ermöglicht, ohne Engpässe auf RAM-Ebene zu verschieben.

Warum gewinnt HBM gegen DDR und GDDR? Bandbreite, Latenzen und Energieverbrauch lassen keine Zweifel

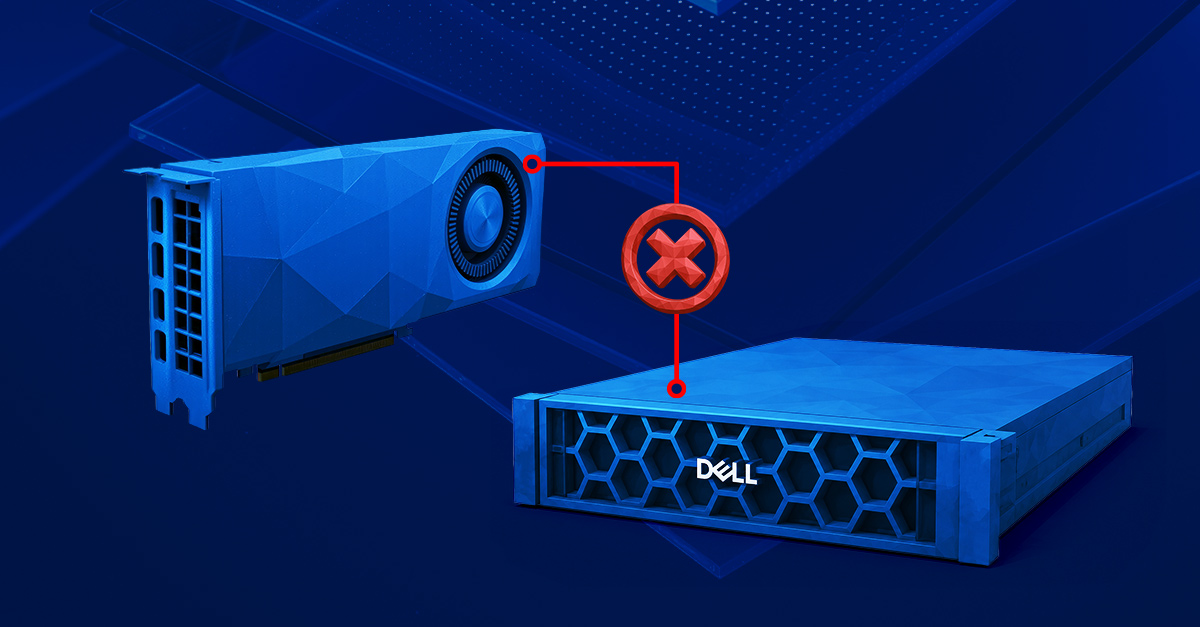

Traditioneller DRAM-Speicher – egal ob wir über DDR5, GDDR6 oder LPDDR sprechen – kann einfach nicht mit der Bandbreite mithalten, die moderne AI-Chips erfordern. HBM bietet nicht nur eine deutlich größere Interfacebreite, sondern macht das auch bei niedrigerer Spannung und geringerem Energieverbrauch. In konkreten Zahlen: HBM verbraucht 3,5 bis 4,5 mal weniger Energie in der PHY-Schicht als GDDR6, bei derselben Bandbreite. Das bedeutet nicht nur Energieeinsparung, sondern auch geringere thermische Anforderungen und höhere Kühlungseffizienz – entscheidend bei der Arbeit in Rechenzentren oder Datenzentren.

Die Bandbreitenunterschiede sind ebenso bedeutsam. GDDR6 endet bei etwa 600 GB/s, während HBM3E bis zu 1,2 TB/s ermöglicht. Außerdem sind die Datenzugriffslatenzen niedriger, nicht nur aufgrund der physischen Nähe der Chips, sondern auch durch die Eliminierung von Verzögerungen, die aus dem klassischen Mainboard-Layout resultieren. Als Ergebnis kann ein AI-Modell nicht nur schneller lernen, sondern auch schneller inferieren – und das ohne Stillstände aufgrund des Wartens auf RAM-Zugriff. Deshalb ist der Übergang zu HBM bei einer Infrastruktur mit intensiven Rechenarbeitslasten keine Option – sondern eine Voraussetzung für stabiles Wachstum.

AI liebt HBM, weil es keine Wahl gibt – traditionelle DRAMs halten nicht mit Modellen mit

Es geht nicht nur darum, dass HBM schneller ist. Es geht darum, dass KI-Modelle heute keine andere Wahl lassen. Wenn Sie es mit Hunderten von Milliarden Parametern, Zehntausenden von Tokens und täglichen Datenbatches in Petabyte-Größe zu tun haben – wird jede Mikrosekunde des Speicherzugriffs zum Engpass. Traditioneller DRAM – selbst in der DDR5-Version – kann nicht die Bandbreite und Dichte wie HBM bieten. Als Ergebnis wartet die Maschine. Und das nicht auf die GPU, sondern auf den RAM.

High Bandwidth Memory entstand genau dafür, dass dieses Problem nicht auftritt. GPUs und AI-Beschleuniger wie NVIDIA H100, AMD MI300 oder Intel Gaudi 3 haben einen so enormen Bandbreitenbedarf, dass ohne HBM ihr Potenzial ungenutzt bliebe. Wie Jim Handy von Objective Analysis sagte – ohne HBM müssten Sie mehrere Prozessoren statt einem haben, was trotzdem nicht den gleichen Effekt gäbe. HBM vereinfacht die Systemarchitektur, reduziert die Anzahl der Komponenten und skaliert linear mit steigenden Anforderungen von AI-Modellen. Dadurch müssen Sie nicht die gesamte Plattform erweitern – es reicht, ein besseres Speicherinterface zu verwenden.

Was kostet HBM und warum ist es trotzdem jeden Cent wert?

Der hohe Preis von HBM ist kein Geheimnis – und kann tatsächlich überraschen. Ein Gigabyte HBM kostet etwa 10,6 Dollar, während DRAM etwa 2,9 Dollar kostet, und DDR5 sogar noch weniger. Aber bei HBM zahlen Sie nicht für die Kapazität. Sie zahlen für Bandbreite, Energieeffizienz und das Fehlen von Engpässen, die sich in AI-Systemen direkt in Modell-Trainingszeit und damit in Betriebskosten übersetzen. Laut Kostenanalysen kostet eine NVIDIA H100 GPU etwa 3000 USD, wobei die Hälfte des Preises allein der HBM-Speicher von SK Hynix ist.

Trotz dieses Preises erreicht die operative Marge für Hersteller sogar 87% – was bedeutet, dass Unternehmenskunden bereit sind zu zahlen, weil sie Vorhersagbarkeit und Leistung gewinnen. Das rechnet sich einfach. Sie trainieren Modelle schneller, das System verbraucht weniger Energie, und effizientes Lastmanagement ermöglicht es Ihnen, Hardware-Ressourcen besser zu nutzen. Selbst wenn Sie am Anfang mehr zahlen, erweist sich der reale ROI (Return on Investment) im Jahresvergleich als günstiger als bei günstigen Systemen mit klassischem DRAM. Besonders wenn Sie Infrastruktur für Jahre bauen, nicht für ein Quartal.

Custom HBM ist die Zukunft – vollständige Kontrolle über Bandbreite und Verbrauch

Standard HBM ist bereits ein mächtiges Werkzeug, aber immer mehr Unternehmen gehen einen Schritt weiter. Custom HBM (cHBM) ermöglicht es, Speicher speziell für bestimmte Aufgaben zu entwerfen – z.B. AI-Inferenz, 3D-Grafiken oder Quantensimulationen. Dank 2.5D-Architektur mit Silizium-Interposern und eigenen Kommunikationskanälen können Unternehmen wie Samsung, SK Hynix und Micron maßgeschneiderte Lösungen anbieten, die genau auf die Bedürfnisse des Kunden zugeschnitten sind.

Custom HBM ist besonders wertvoll in Umgebungen, wo Standardspezifikationen nicht ausreichen – z.B. in militärischen Anwendungen, wissenschaftlichen Simulationen oder fortgeschrittenen Renderingpipelines. Dank der Möglichkeit, Parameter wie Busbreite, Latenz, Energieprofil und sogar Kühlanforderungen anzupassen, können Unternehmen Hardware erhalten, die perfekt auf ihre Arbeitslasten abgestimmt ist. Das Ergebnis? Höhere Effizienz, niedrigere Betriebskosten und die Möglichkeit, Wettbewerbsvorteile in Märkten zu erlangen, wo jede Millisekunde zählt.

Achtung vor Verfügbarkeit – HBM kann schneller ausgehen, als Sie Ihr Projekt planen können

Hohe Nachfrage nach HBM führt zu einem Problem, das viele Unternehmen unterschätzen – Verfügbarkeit. Da die meisten fortgeschrittenen KI-Chips HBM-Speicher erfordern, und die Produktionskapazitäten begrenzt sind, können Lieferzeiten mehrere Monate betragen. Das bedeutet, dass die Planung von Infrastruktur-Upgrades weit im Voraus erfolgen muss – manchmal sogar ein Jahr vor dem geplanten Deployment.

Besonders problematisch wird es bei großen Projekten, wo Hunderte von GPUs mit HBM benötigt werden. Ohne langfristige Verträge oder Vorabbestellungen riskiert man, dass das Projekt verzögert wird, nicht wegen technischer Probleme, sondern wegen Materialmangel. Deshalb ist es wichtig, bei der Projektplanung nicht nur die technischen Anforderungen, sondern auch die Lieferkette zu berücksichtigen. In einer Branche, die sich so schnell entwickelt wie AI, kann eine verzögerte Lieferung bedeuten, dass die Konkurrenz Sie überholt.

/ EUR

/ EUR