Das Modell ist bereits trainiert? Jetzt ist es Zeit, dass es in der Produktion arbeitet – schnell, stabil und ohne Engpässe. Genau hier kommt AI Inference ins Spiel, also die Phase, in der Ihr Modell reale Daten verarbeitet und Ergebnisse in Echtzeit zurückgibt. Aber damit das Sinn macht, brauchen Sie gut gewählte Hardware: einen Inference-Server, der die Last trägt, mit entsprechender GPU und CPU, optimiert nicht für Training – sondern für Leistung und Skalierbarkeit von Anfragen.

AI Inference in der Praxis – was beeinflusst Antwortzeit und Skalierbarkeit wirklich?

Wenn Sie AI-Modelle in Produktionsumgebungen implementieren, wissen Sie, dass die Antwortzeit wichtiger wird als das Modellergebnis selbst. Genau in der AI-Inference-Phase – also beim Schlussfolgern aus bereits trainierten Modellen – entsteht Druck auf Millisekunden. Für Systeme, die Chatbots, Echtzeitanalysen, IoT, Video-Monitoring oder Empfehlungsengines bedienen – zählen vor allem Latenz, Durchsatz und Skalierbarkeit. Es geht nicht mehr darum, wie genau das Modell ist – sondern ob es 10.000 Anfragen gleichzeitig ohne Verzögerungen bearbeiten kann.

Auf dieses Ergebnis wirken mehr Faktoren ein, als es scheinen mag. Entscheidend sind:

-

GPU-Inference-Leistung,

-

niedrige Latenz von RAM und NVMe-Festplatten,

-

gute Kühlung,

-

effiziente Bearbeitung vieler paralleler Anfragen,

-

Unterstützung für INT8- oder FP16-Formate.

In modernen Umgebungen werden Tools wie Triton Inference Server eingesetzt, die Anfrage-Warteschlangen dynamisch verwalten und die Last an verfügbare GPU-Ressourcen anpassen. Ein gut optimierter Inference-Server kann sogar hunderttausende Anfragen täglich verarbeiten, bei geringer Latenz und minimalem Energieverbrauch. Deshalb spricht man heute von "produktivem Inference" als eigenständiger Spezialisierung – das ist nicht mehr nur das Starten eines Modells, sondern eine vollwertige operative Architektur.

GPU-Inference ohne Bottlenecks – wie wählt man Beschleuniger nach Anzahl der Anfragen?

Die GPU-Wahl für Inference ist mehr als "hat sie viel VRAM". Für die meisten in der Produktion verwendeten Modelle (LLM, visuelle Netzwerke, Klassifikatoren, Empfehlungsengines) ist wichtiger als reine Leistung, wie eine bestimmte GPU Berechnungen niedriger Präzision (FP16, INT8) verarbeitet, wie ihre Durchsatzarchitektur aussieht und ob sie gleichzeitige Verarbeitung mehrerer Streams ermöglicht. Anders gesagt – GPU-Inference darf nicht von einem großen Modell "belegt" werden, wenn sie in einer Umgebung mit hohem QPS (Queries per Second) funktionieren soll.

Unter den derzeit in Inference-Systemen verwendeten beliebten Modellen sind NVIDIA A2, A10, L40s sowie Jetson Orin für Edge AI erwähnenswert – alle bieten ein hervorragendes Preis-Leistungs-Verhältnis, werden von Frameworks wie TensorRT, Triton und Red Hat AI Inference Server unterstützt und benötigen keine speziellen Gehäuse mit starker Kühlung.

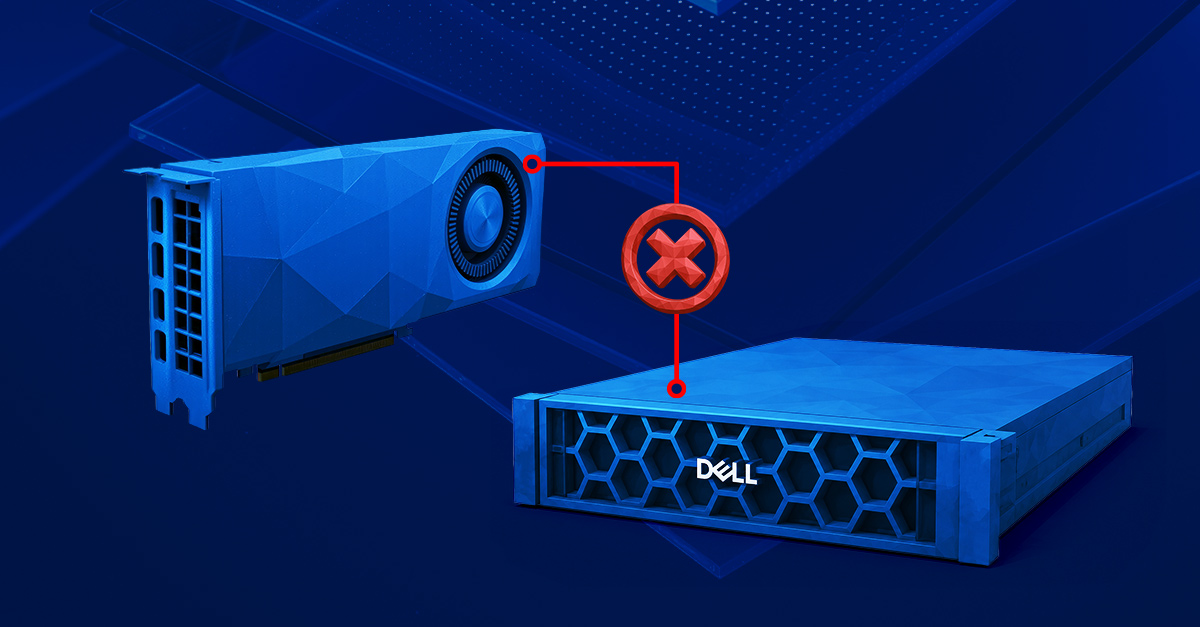

Beispielsweise: Dell PowerEdge R760xa mit A10 kann bis zu 3-mal mehr Anfragen als ältere T4-basierte Lösungen verarbeiten, bei geringerem Energieverbrauch und stabilerer Arbeit unter hoher Last. Wichtig – GPU-Inference sollte man nicht nur hinsichtlich Leistung planen, sondern auch Verfügbarkeit und Skalierbarkeit innerhalb des Rack-Schranks. Wenn Sie heute mit einer Karte beginnen, aber in einem halben Jahr vier brauchen – stellen Sie sicher, dass Mainboard, Netzteil und Kühlung das ermöglichen.

Inference-Server für LLM – welche CPU und wieviel RAM macht heute Sinn?

Bei Sprachmodellen und generativen Aufgaben, wo Antwortzeit und Parallelität wichtig sind, hört CPU auf, "nur" Systemunterstützung zu sein – sie beginnt eine unterstützende Inference-Rolle zu spielen. Wenn Sie mit großen Transformer-Modellen arbeiten (z.B. BERT, GPT, T5), können Preprocessing und Ein-/Ausgabe-Behandlung, Batch-Verarbeitung von Anfragen oder Kontextanalyse den Prozessor solid belasten, besonders bei Echtzeit-Inference. Deshalb sollte ein Inference-Server für LLM mindestens 32 physische Kerne haben, oft mehr – 64 oder 96 in Enterprise-Umgebungen.

Dazu kommt der Arbeitsspeicher – wenn die Anwendung reibungslos ohne unnötige Verzögerungen funktionieren soll, sind 128–256 GB ECC DDR5 heute eine vernünftige Basis, besonders wenn der Server parallel mehrere Modelle oder Container-Instanzen verarbeiten soll.

Unter empfohlenen Modellen sind Supermicro SYS-421GE-TNHR, Lenovo ThinkSystem SR670 V2 sowie Dell PowerEdge R760xa erwähnenswert, die volle Flexibilität bezüglich CPU-GPU ermöglichen, skalierbar sind und PCIe Gen5 sowie NVMe Gen4 unterstützen. Nicht unwichtig ist auch, dass die meisten von ihnen Service über iDRAC/IMM/IPMI unterstützen, was die Verwaltung in Produktionsumgebungen erheblich vereinfacht. Die CPU- und RAM-Wahl darf nicht zufällig sein – sie bedingt, wie effektiv GPU mit Inference unter kontinuierlicher Last zurechtkommt.

Edge AI-Server im Feld – kompakt, schnell, bereit für Monitoring und IoT

Nicht jede Inference-Infrastruktur arbeitet im Rechenzentrum. Immer mehr Implementierungen finden in Industrieanlagen, Verkaufsstellen, Krankenhäusern, Transport oder Monitoring-Systemen statt – also überall dort, wo Daten lokal und sofort analysiert werden müssen. In solcher Umgebung muss ein Edge AI-Server kompakt, leise, energieeffizient und widerstandsfähig gegen variable Arbeitsbedingungen sein, gleichzeitig aber stark genug, um Echtzeit-Inference auszuführen.

Modelle wie NVIDIA Jetson AGX Orin, Lenovo SE350 oder Dell PowerEdge XR4000 wurden genau für dieses Szenario entwickelt. Sie haben eingebaute GPU-Inference-Beschleuniger, arbeiten ohne Lüfter (oder mit geschlossener aktiver Kühlung), und ihre TDP übersteigt oft nicht 250 W für die gesamte Einheit.

Wichtig – viele von ihnen haben Kompatibilität mit Container-Management-Systemen (z.B. K3s, Docker) und können offline arbeiten, mit Datensynchronisation erst über Netzwerk. Solche Lösungen sind heute keine Kuriosität, sondern reale Alternative zu Mini-Rechenzentren – besonders wenn Sie AI an der Produktionslinie, an der Grenze, im Fahrzeug oder im CCTV-System brauchen. Edge-Inference ist nicht die Zukunft – es ist Standard in vielen Branchen, der bereits jetzt die Art der Datenverarbeitung verändert.

Leistungsstark und günstig? Diese Inference-Server-Konfigurationen erfordern keine Millionen für den Start

Entgegen dem Anschein muss AI-Inference-Implementierung nicht mit einer sechsstelligen Rechnung beginnen. Wenn Sie Ihre Last kennen und die Anzahl der Anfragen vorhersagen können, lässt sich eine leistungsstarke, skalierbare und stabile Plattform für einen Bruchteil des "Enterprise-ready"-Preises aufbauen. Beispiele? Dell PowerEdge R660xs mit A10 oder A2, Lenovo SR645 mit 2x EPYC 7313 und RTX 6000 Ada, oder sogar Tower Dell T560 mit RTX 4070 Ti Super und 256 GB RAM – all diese Konstruktionen sind in inference-bereiten und AI-lastgetesteten Konfigurationen verfügbar.

Am wichtigsten ist, nicht für Funktionen zu überzahlen, die Sie nicht nutzen. Wenn Sie keine 8xGPU brauchen, investieren Sie nicht in einen Server mit 4 Netzteilen und 3U – konzentrieren Sie sich auf optimale Konfiguration, die leicht zu warten und zu erweitern ist. Dazu sollten Sie Software-Layer wie Triton, OpenVINO oder ONNX Runtime implementieren, die helfen, das Maximum aus dem herauszuholen, was Sie haben. Manchmal bringt ein gut konfigurierter Inference-Server mit einem A10 bessere Ergebnisse als ein schlecht belasteter Server mit zwei L40s. AI-Inference ist ein Spiel um Balance – nicht nur der Leistung, sondern auch von Budget, Effizienz und Kontrolle.

Braucht jedes Unternehmen einen dedizierten Inference-Node? Wann ist Hybrid besser

Nicht jede Organisation muss sofort dedizierte Inference-Infrastruktur aufbauen. Für viele Unternehmen kann eine profitablere und flexiblere Lösung Hybrid sein – also die Kombination lokaler Inference-Server mit Cloud-Ressourcen oder Edge-Nodes. Dieses Modell bewährt sich besonders bei unregelmäßigen Lasten, sich dynamisch ändernden Projekten oder wenn eine Inference-Instanz konstant läuft und andere nur temporär (z.B. in Marketing-Kampagnen, saisonalem Traffic).

In diesem Szenario können Sie einen lokalen AI-Inference-Node im Büro aufstellen (z.B. Dell T560 mit A10), ihn mit einer Edge-Maschine im Werk verbinden (z.B. Jetson Orin oder Lenovo SE350), und das Ganze ist mit einer zentralen API in der Cloud verbunden. Das ist eine flexible und skalierbare Lösung, die Kontrolle über wichtige Daten gibt und gleichzeitig schnelle Experimente nicht blockiert. Denken Sie daran, dass ein Inference-Server nicht alles verarbeiten muss – manchmal ist es besser, die Architektur modular zu entwerfen, mit Aufteilung auf Aufgabentypen, Standorte und SLA. Dadurch vermeiden Sie sowohl Überlastungen als auch unnötige Investitionen. Inference im Jahr 2025 ist nicht mehr nur Leistung – es ist vor allem vernünftige operative Strategie.

/ EUR

/ EUR