Das Training großer AI-Modelle ist kein Spiel für gewöhnliche Desktops. Wenn Sie LLM ausführen, Big Data verarbeiten oder eigene Deep-Learning-Lösungen entwickeln möchten - müssen Sie wissen, welcher AI-Server diese Aufgabe wirklich bewältigt. Die Wahl endet nicht bei "nimm etwas mit RTX" - die gesamte Plattform zählt: GPU, CPU, RAM, Storage, Kühlung und Skalierbarkeit.

AI-Server - welche GPU brauchen Sie wirklich für Deep Learning?

Die GPU-Wahl für AI-Aufgaben reduziert sich heute nicht auf die Aussage "nimm etwas aus der RTX-Serie". Wenn Ihnen die Leistung beim Training großer Modelle, generativer neuronaler Netzwerke oder LLM wichtig ist, dann zählen nicht nur die Anzahl der CUDA-Kerne, sondern auch VRAM, Speicherbandbreite, Tensor-Core-Unterstützung und Kompatibilität mit AI-Frameworks. In realen Produktionsimplementierungen sind NVIDIA H100, A100, L40s sowie A800 Standard, verfügbar u.a. in Konstruktionen wie Dell PowerEdge XE9680, Lenovo SR670 V2 oder Supermicro AS-4125GS-TNRT.

Wenn Sie nicht so viel Leistung brauchen, aber kleinere Modelle trainieren oder bestehende Architekturen fine-tunen möchten - z.B. in Forschungs- und Entwicklungsumgebungen - bewähren sich auch RTX A6000, 4090 oder sogar 4070 Ti Super, die immer noch sehr gute Leistung im Verhältnis zu den Kosten bieten. Bei der GPU-Wahl orientieren Sie sich nicht ausschließlich an Gaming-Benchmarks - wichtiger sind: VRAM-Menge (mindestens 24 GB in ernsthaften Projekten), Mixed-Precision-Unterstützung (FP16, BF16) und Effizienz bei der Arbeit mit großen Daten-Batches. Und wichtig - AI-Server sollten GPU-Erweiterung ermöglichen, am besten in modularer Form oder mit vollständiger PCIe Gen5-Unterstützung.

Deep Learning Server in der Praxis - wieviel RAM, welches Storage, wie mit der Kühlung?

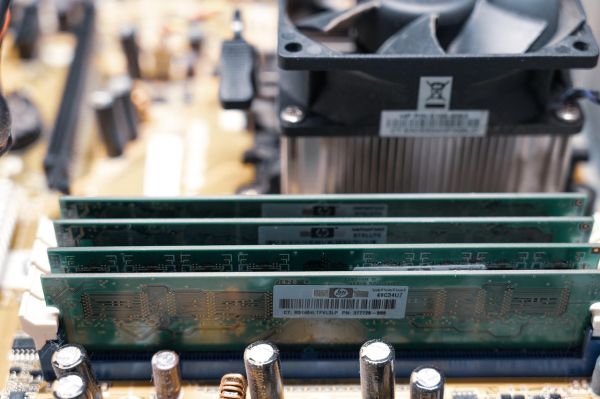

Wenn Sie die AI-Server-Konfiguration betrachten, ist es leicht, sich nur auf die GPU zu konzentrieren. Aber die Wahrheit ist, dass ohne angemessen gewählte Rest-Plattform - RAM, CPU, Storage und Kühlung - die GPU-Leistung begrenzt wird. Deshalb sind in professionellen AI-Umgebungen mindestens 128 GB RAM Standard, und in Enterprise-Servern findet man oft 512 GB, 1 TB oder sogar 4 TB, besonders bei der Arbeit mit mehreren Modellen oder komplexen Preprocessing-Pipelines. Wichtig - der Speicher sollte ECC-Typ sein, denn Speicherfehler bei langem Training sind etwas, was Sie wirklich nicht erleben wollen.

Was Storage angeht, ist NVMe heute Pflicht. SATA SSD schafft es nicht beim schnellen Laden von Daten aus riesigen Datensätzen, besonders wenn mehrere GPUs parallel arbeiten. Server wie Lenovo SR670 V2 oder Dell PowerEdge XE9680 bieten nicht nur Platz für viele GPUs, sondern auch volle Unterstützung für ultraschnelle NVMe Gen4 SSD, und neuere Modelle - sogar Gen5. Dazu kommt das Thema Kühlung - 4 oder 8 H100-Karten bedeuten enorme Wärmeabgabe, also investieren Sie entweder in einen Server mit aktiver Flüssigkeitskühlung (z.B. Supermicro) oder sorgen für ein hochwertiges Lüftungssystem und redundante PSU mindestens 2 kW.

Nur dann macht ein Deep Learning Server in Produktionsumgebungen Sinn und erfordert nicht jeden zweiten Tag manuellen Neustart.

Machine Learning Server - welche CPU macht Sinn bei der Arbeit mit großen Modellen?

Entgegen dem Anschein ist CPU im AI-Server nicht nur für "Systemunterstützung" da. Bei großen Machine Learning-Pipelines, Preprocessing, Dekodierung, Augmentation oder bloßen IO-Operationen können oft mehr Zeit brauchen als das Training selbst - sofern die CPU nicht mithalten kann. Deshalb sollte ein guter Machine Learning Server einen Prozessor haben, der kein Engpass ist. Auf dem Markt dominieren heute zwei Architekturen: Intel Xeon Scalable (Gen. 5) sowie AMD EPYC 9004 "Genoa". Beide bieten von einigen Dutzend bis über 90 physische Kerne pro Socket, volle DDR5-Unterstützung, viele PCIe Gen5-Linien und hervorragende Effizienz bei Multithreading-Arbeit.

In der Praxis - wenn Sie mehrere Modelle parallel trainieren oder Daten in Echtzeit pipelinen möchten, zielen Sie auf min. 32-64 physische Kerne und Taktung über 3 GHz. Server-Modelle wie Supermicro AS-4125GS-TNRT oder Dell PowerEdge R760xa (zuverlässig, aber seltener erwähnt als XE9680) ermöglichen volle Flexibilität bezüglich CPU-GPU-RAM. In Testumgebungen oder bei Budgets unter 30.000 € sollten Sie Threadripper PRO 7000 oder Xeon W-3400 in Betracht ziehen, die GPU-Erweiterung etwas begrenzen, aber problemlos 2-3 Top-Karten und mehrere VMs gleichzeitig bewältigen. Gut gewählte CPU beschleunigt das Training nicht direkt - verkürzt aber erheblich die Zeit des gesamten ML-Zyklus.

Nicht nur H100 - alternative AI-GPU, die Sie kennen sollten (und nicht überzahlen)

Wenn Sie an AI-Server-Hardware denken und überall nur H100 und A100 sehen, ist das... nicht verwunderlich. Das sind Rechenmonster, die sich hervorragend in Clustern skalieren lassen und die größten Modelle verarbeiten. Nur dass nicht jedes Projekt das braucht. Für mittelgroße Unternehmen oder Startups können weniger "gehypte" Karten die bessere Wahl sein, die einen Bruchteil des Preises kosten und bei Inference oder Fine-Tuning gar nicht so viel schlechter sind. Beispiele? NVIDIA RTX A6000, L40s, A800 oder sogar 4090 - das sind GPUs, die in Workstations oder Rack-Servern problemlos mit dem Training von Transformern oder Sprachmodellen von einigen Milliarden Parametern zurechtkommen.

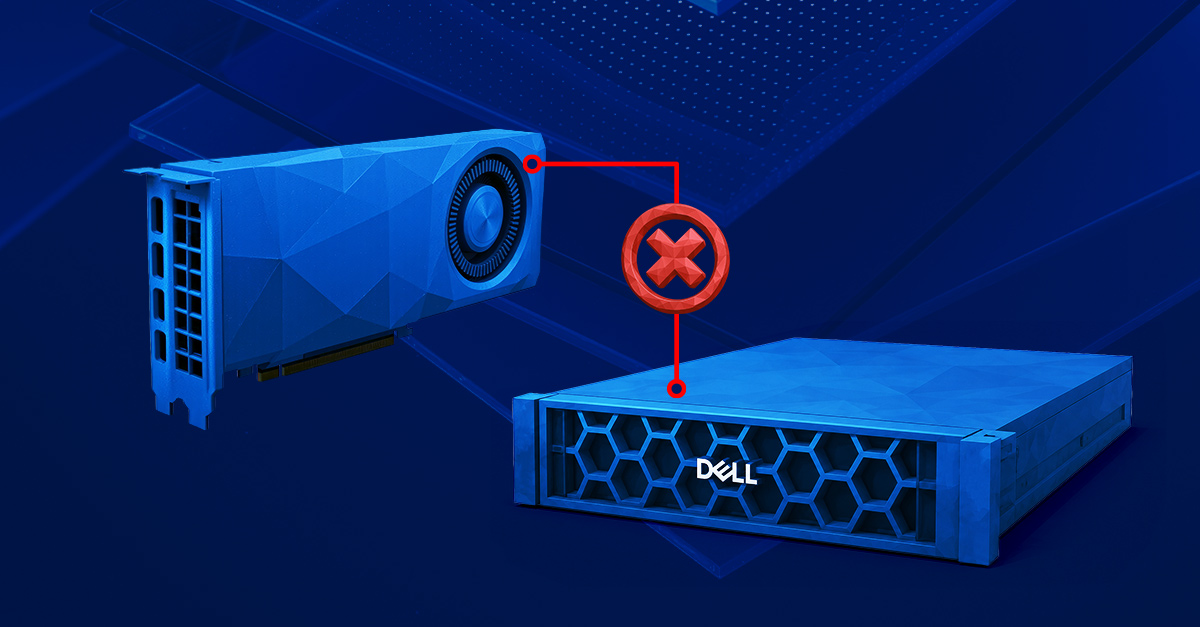

Dazu kommt AMD Instinct MI300, die an Popularität gewinnt, besonders in Open-Source-Umgebungen, wo keine Notwendigkeit besteht, Lösungen aus dem CUDA-Ökosystem zu nutzen. Auf dem Markt gibt es auch Server, die verschiedene GPU-Klassen in einem Gehäuse kombinieren, z.B. Dell PowerEdge T640 - hervorragend für Test-Dev-Umgebungen, wo Sie RTX 4070 Ti mit A6000 mischen und Modellverhalten in verschiedenen Konfigurationen testen können. Nicht jede AI-Implementierung braucht H100 - und sehr oft ist es besser, 2-3 "günstigere" Karten zu kaufen, die Flexibilität und schnelle Time-to-Market geben, ohne auf Kaufgenehmigung für eine halbe Million Euro zu warten.

Flexible AI-Server - wann reicht Tower, wann brauchen Sie Blades?

Nicht jedes AI-Projekt erfordert ein Serverraum und Wasserkühlung. Wenn Sie gerade eine Umgebung aufbauen oder die F&E-Abteilung entwickeln, kann ein gut konfigurierter Tower durchaus ausreichen - z.B. Dell T640 mit 2x Xeon Gold, 512 GB RAM und mehreren Slots für RTX A6000-Karten - das ist eine Konstruktion, die unter den Schreibtisch passt und gleichzeitig mehrere Wochen soliden Trainings bewältigt. In vielen Fällen ist genau der Formfaktor entscheidend - Sie brauchen nicht immer ein volles Rack, besonders bei kleineren Datensätzen und kürzeren Modell-Iterationen.

Andererseits - wenn Sie an Skalierung, Multi-GPU, Integration mit Cluster oder hybrider Umgebung denken, sollten Sie auf modulare Rack- oder Blade-Lösungen setzen. Plattformen wie Dell PowerEdge FX2s (4 Nodes FC640/FC830) ermöglichen einfache Erweiterung, schnelle Ressourcen-Rekonfiguration und bessere Energie- und Netzwerkverwaltung. Das ist eine Lösung für diejenigen, die AI als langfristige Investition betrachten, nicht als Experiment. Flexible AI-Server ermöglichen die Form an die Bedürfnisse anzupassen - und das ist oft wichtiger als der Karten-Benchmark selbst.

Cloud oder physischer AI-Server? Wann lohnt es sich, eigene Umgebung aufzubauen

Die Entscheidung, ob Cloud oder eigene Hardware, ist keine Ideologie-Frage - sondern eine Frage von Zeit, Umfang und Vorhersagbarkeit. Cloud hat enorme Vorteile: Sie zahlen nicht im Voraus, skalieren "auf Anfrage", testen viele Konfigurationen ohne Mittel-Einfrierung. Wenn Sie MVP aufbauen, Modelle einmal im Monat trainieren oder einfach noch keine Infrastruktur haben - wird Cloud (z.B. OVH, Azure, AWS) die profitabelste Wahl sein. Aber das bedeutet nicht, dass es immer günstig wird.

Wenn das Projekt wächst, Modelle größer werden und Inference im 24/7-Modus läuft - kann Cloud dutzende Male mehr kosten als ein physischer Deep Learning Server. Zusätzlich kommen Compliance-Themen, Datenschutz, DSGVO-Konformität - und dann gibt eigene Infrastruktur Ruhe. Wenn Sie mit stabiler Last rechnen, eigenes Team haben und die gesamte Pipeline kontrollieren - beginnt sich ein einmal gekaufter, gut gewählter und erweiterbarer AI-Server sehr schnell zu amortisieren. Im Jahr 2025 können die Kosten für 8xH100 in der Cloud mehrere zehntausend Euro monatlich erreichen - und physische Hardware amortisiert sich nach 4-6 Monaten. Deshalb muss die Entscheidung auf das reale Szenario zugeschnitten sein, nicht nur auf Excel-Simulation.

/ EUR

/ EUR